Un grupo de investigación de Enginyeria del Llenguatge i Reconeixement deFormes (ELiRF) integrado en el Instituto Valenciano de Investigación en Inteligencia Artificial (VRAIN) de la Universidad Politécnica de Valencia (UPV) ha desarrollado un software que integra diferentes modelos y tecnologías para la monitorización y análisis multilingüe de las redes sociales, capaz de interpretar la ironía y las emociones en los textos incluso en idiomas menos extendidos.

El equipo lleva 20 años trabajando en temas de reconocimiento de formas, Speech y procesamiento del lenguaje natural, y desde hace 10 años en las redes sociales, donde hacen seguimiento de personajes públicos, la imagen de las empresas, de instituciones o personajes públicos. “Es evidente el gran interés que las diferentes organizaciones tienen en conocer la repercusión que tienen sus actividades entre el colectivo al cual van dirigidas”, explica a este medio uno de los participantes de la investigación Ferrán Pla, profesor de la Escuela Técnica Superior de Ingeniería Informática.

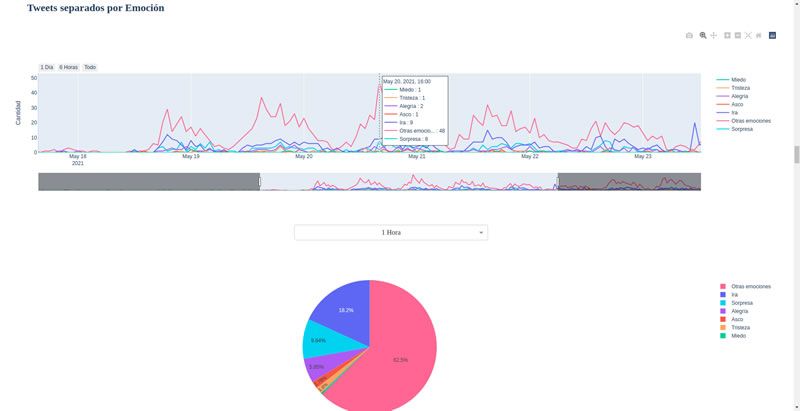

El sistema creado para detectar las emociones funciona a través de técnicas de ‘deep learning’ y procesamiento del lenguaje natural. A solicitud del usuario, monitoriza las redes sociales para obtener la información asociada a los temas objeto de interés y ofrecerá los resultados de forma gráfica a través de la web o mediante la generación de informes.

“Nuestro sistema utilizan datos de aprendizaje de colecciones de textos anotados con la información que deseemos incorporar”

“Las técnicas de aprendizaje autonómico están avanzando mucho. Nuestro sistema utiliza datos de aprendizaje de colecciones de textos anotados con la información que deseemos incorporar. Además utilizamos grandes colecciones de textos no etiquetados para obtener representaciones vectoriales densas de las palabras (embeddings)”. Esto, como señala Pla permite reconocer emociones e incluso intencionalidades tan difíciles de interpretar por texto como la ironía.

Frente a sus competidores, los investigadores destacan la capacidad del sistema para realizar “un análisis profundo de los textos para poder clasificarlos". Gracias al procesamiento del lenguaje y a reconocer diferentes fenómenos de éste, el software es capaz de reconocer la ironía, la negación y las emociones, entre otras cuestiones. Es capaz de determinar la polaridad global de los tuits, si son positivos, negativos o neutros.

Además, es capaz de detectar idiomas que incluso los sistemas comerciales no reconocen. Así, de momento detecta el español, el inglés y el valenciano, pero está preparado para introducir cualquier otro idioma. “En principio nuestros sistemas se pueden entrenar y por lo tanto utilizar para cualquier idioma que disponga de recursos para el entrenamiento. Estos son los tres idiomas que hemos trabajado hasta el momento y que dispones de test de referencia para comprobar las prestaciones de nuestros modelos”

“Se podrían aprender modelos que permitirían detectar posibles casos de acoso, amenaza, etc., pero se debe respectar a la ley de protección de datos”, señala Ferrán Pla

Los investigadores esperan poder implantarlo en empresas e instituciones, pues supone un apoyo para aquellas empresas y organizaciones. También podría servir para los servicios de emergencia, que requieren de un análisis constante de las redes sociales.

Sin embargo, no es fácil. La detección de casos como depresión, intentos de suicidio, acoso, bulling o amenaza necesita de datos que recogieran este problema, pero conseguirlos sin romper la ley de protección de datos no es sencillo. “Suponiendo que existirán estos datos se podrían aprender modelos que permitirían detectar posibles casos de acoso, amenaza, etc., pero se debe tener en cuenta que el uso de estos modelos debe respectar a la ley de protección de datos”, señala Ferrán Pla.

En el desarrollo el VRAIN ha contado con la colaboración del Instituto Valenciano de Informática (ITI) y la Corporación Valenciana de Mitjans de Comunicación (CVMC), y con la financiación de la Agencia Valenciana de la Innovación (AVI).